La prévention des risques professionnels de l’Intelligence Artificielle

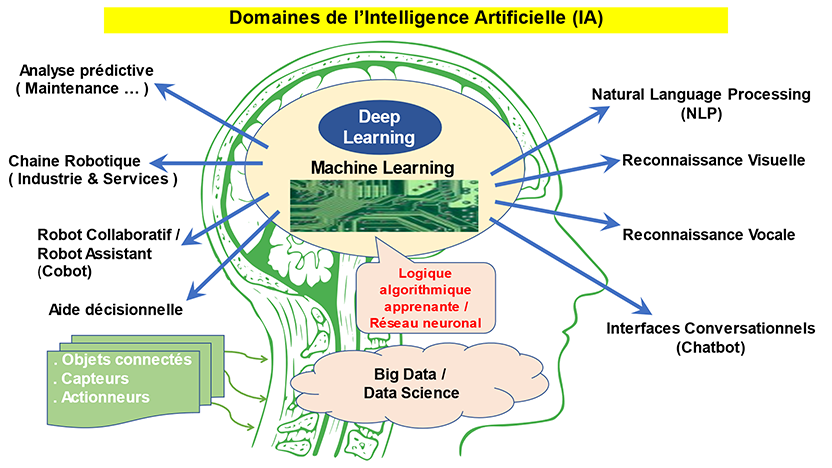

Les applications dotées d’Intelligence Artificielle (IA) sont pilotées par un logiciel qui se caractérise par sa capacité à analyser de grands volumes de données (Big Data), et par des algorithmes qui le rendent capable d’apprentissage (Machine Learning), leur conférant une certaine autonomie ; en particulier avec l’apprentissage profond (Deep Learning) qui consiste à ce que l’IA acquière de nouvelles compétences et de l’auto-adaptativité à travers un réseau neuronal en couches multiples.

L’intelligence artificielle va transformer profondément les secteurs de l’industrie et des services : « en simplifiant et automatisant leurs processus, les entreprises peuvent augmenter sensiblement leur productivité et alléger leur structure de coûts » (Accélérer la mutation numérique des entreprises : McKinsey).

Tous les secteurs économiques sont concernés, et les applications dans les domaines industriels, administratifs, commerciaux et ceux des services sanitaires, bancaires, domestiques, sécuritaires ... sont très nombreuses :

- Les chaines robotiques dans la logistique, l’automobile, l’électronique, l’agroalimentaire etc., les opérations de maintenance prédictive, l’assistance par les robots collaboratifs (cobots) ou mobiles qui partagent un même espace de travail en réalisant des travaux avec les opérateurs ou en s’y substituant ;

- La reconnaissance visuelle et verbale et les interfaces conversationnels (chatbots) dans les relations commerciales, les activités de sécurité et surveillance ... ;

- Les aides à la prise de décision (stratégique, marketing, managériale, médicale ...) ;

L’usage de l’intelligence artificielle en entreprise soulève des questions nouvelles relatives aux risques professionnels et à la protection des travailleurs des conséquences des transformations nombreuses du travail : si une application l’utilise, il faut par exemple s’assurer que les données ne soient pas biaisées de façon à ne pas donner de résultats discriminants en matière de gestion des Ressources Humaines notamment. Au-delà des risques physiques induits par le dysfonctionnement d’un robot, des risques psychologiques sont en particulier liés à l’interaction homme-machine : sentiments de dépendance, de perte d’autonomie et d’identité, excès de charge mentale ....

Les préoccupations croissantes des risques de l’intelligence artificielle et du Machine Learning en entreprise tient à son intégration dans les machines automatisées et dans le monitoring du travailleur, avec des enjeux juridiques, éthiques, sociaux et réglementaires : l’apparition du technostress, l’exploitation des données personnelles sur les lieux de travail, les dimensions de sécurité et de latitude décisionnelle des interactions entre l’être humain et la machine, la transparence des algorithmes de surveillance etc.

Si l’IA en entreprise recèle ainsi de nombreuses potentialités, elle engendre aussi des risques professionnels nouveaux plus difficiles à appréhender dont la gestion est complexe et encore incertaine : d’une part, les risques rattachés à des défauts de conception, et d’autre part, les risques associés à l’apprentissage machine. Pour avoir des principes et règles éthiques et dignes de confiance, l’IA doit respecter les valeurs de traçabilité, de transparence, d’explicabilité et de contrôle. Il s’agit de déployer et de gérer des systèmes de contrôle intelligents explicables, vérifiables, réutilisables et fiables.

Caractéristiques et Usages de l’Intelligence Artificielle en entreprise

- Définitions et caractéristiques de l’intelligence artificielle

L’intelligence artificielle s’inspire de l’intelligence naturelle avec des systèmes ou des machines qui imitent l’intelligence humaine pour effectuer des tâches complexes à partir d’algorithmes et d’informations collectées provenant de sources multiples dans l’environnement, tout en s’améliorant grâce à l’apprentissage et à l’expérience.

On distingue deux types d’intelligence artificielle :- L’IA faible est une intelligence artificielle qui se concentre sur une tâche particulière, conçue et entraînée avec un comportement spécifique limité (narrow AI), par exemple la reconnaissance vocale automatique « speech to text ».

Les logiciels d’IA se différencient des logiciels classiques, car il s’agit d’algorithmes non pas totalement et explicitement programmés à l’avance, c’est-à-dire prédéterminés, mais « entraînés », c’est-à-dire aptes à modifier au fur et à mesure leur comportement grâce à leur expérience.

- L’IA forte dispose de capacités cognitives beaucoup plus larges de raisonnement autonome, voire d’émotion : encore au stade très expérimental, il n’y a à ce jour aucune application opérationnelle.

Les algorithmes d’apprentissage machine (Machine Learning, ML) utilisent des données historiques comme base de leur modèle. il s’agit de se procurer des données pertinentes provenant de différentes sources, analyser statistiquement ces données, par exemple établir des corrélations entre elles, et les rendre disponibles afin d’entraîner des modèles d’intelligence artificielle. L’apprentissage machine permet aux applications logicielles d’être plus efficaces dans des situations très complexes, de réaliser une action définie sans avoir à se référer à des instructions précises et figées, ou résoudre les problèmes de manière autonome dans une situation évolutive.

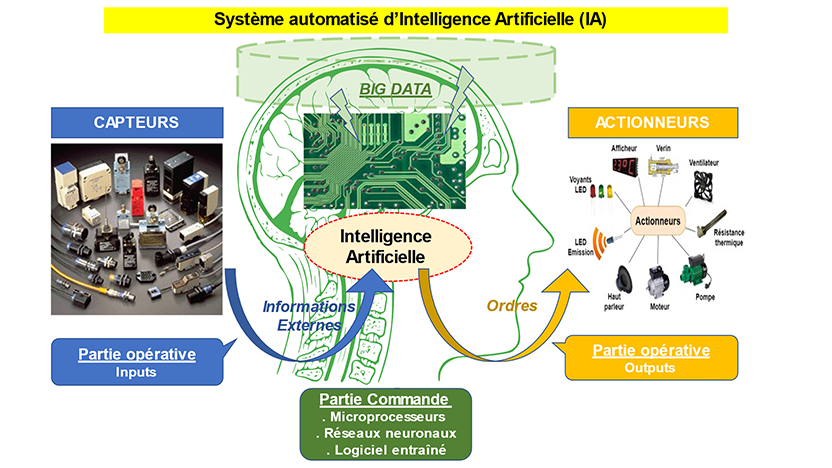

Alors que pour les systèmes automatisés classiques, tout est spécifié et le comportement est vérifiable et explicable même s’il s’agit d’actions régies par des tables de décision avec des myriades de combinaisons de paramètres, les systèmes intégrant de l’intelligence artificielle utilisent cette phase d’apprentissage pour s’ajuster en fonction de leurs observations préalables : la logique de l’IA n'est pas déterministe, elle incorpore des éléments statistiques et est au centre de systèmes qui améliorent leurs performances en fonction des données qu’ils traitent. Mais, de la sorte, les performances d’une intelligence artificielle varient beaucoup en fonction de la quantité et de la qualité des données utilisées en temps réel, grâce à l’intégration de multiples capteurs de données externes en entrée et à l’accès à un Big Data, pour analyser et exploiter les données qui en sont issues.

Ainsi, le développement de l'Intelligence Artificielle exige un grand nombre de données fiables (Big Data), et a besoin d’un gigantesque gisement à exploiter pour chaque domaine d’application.

Le Deep Learning (apprentissage profond) est une extension du Machine Learning, qui a recours à un réseau neuronal de plusieurs couches inspiré du cerveau humain, et fait l’apprentissage de différentes étapes d’un processus au lieu de se focaliser sur une seule, ce qui nécessite énormément de données et de puissances de calcul pour s'entraîner : la très forte croissance de celles-ci vont permettent à l’intelligence artificielle de générer des couches de neurones toujours plus complexes et denses. Le réseau profond dispose d’un mécanisme d’association en continu : grâce à cet énorme pouvoir d’association, le Deep Learning acquière des formes d’expertise.

Le Deep Learning s’enrichit de nouvelles compétences en intégrant de lui-même pas à pas de nouvelles règles, sans intervention humaine. Le développement d’applications plus générales et plus vastes est ainsi rendu possible, et le Deep Learning va devenir la discipline phare de l’IA. - Les apprentissages d'Intelligence Artificielle et leurs algorithmes

L’Intelligence Artificielle est élaborée à l'aide de plusieurs types d’apprentissage : l'apprentissage supervisé, l'apprentissage non supervisé et l'apprentissage par renforcement :

- Apprentissage supervisé : C'est le processus d'entraînement le plus courant pour les algorithmes d'IA. Il implique la fourniture à l'algorithme d'un grand nombre d'exemples d'entrée avec des étiquettes correspondantes indiquant ce que l'algorithme doit prédire. L'algorithme utilise ces exemples étiquetés pour apprendre à faire la correspondance entre les entrées et les étiquettes, ce qui permet alors de renseigner de nouvelles entrées. Pour ce type d'IA, le principe est de collecter beaucoup de données, les étiqueter afin d’indiquer à la machine les correspondances qu’elle doit rechercher, et d'appliquer un algorithme permettant d'en extraire des régularités qui peuvent être ensuite exploitées pour effectuer des prédictions. Cette méthode nécessite moins de données d’entraînement, mais suppose un couteux étiquetage. Risque de surapprentissage rendant le modèle trop sensible, ou, au contraire, risque de sous-apprentissage avec de nombreux résultats biaisés.

- Apprentissage non supervisé ou automatique : Cette méthode d'apprentissage implique la fourniture à l'algorithme d'un très grand nombre d'exemples d'entrée sans étiquettes : l’étiquetage va être réalisé par l’algorithme lui-même qui utilise ces entrées pour apprendre (machine learning) à détecter les structures et les relations dans les données, les « patterns » , c’est à dire des motifs récurrents dans les ensembles de données (chiffres, mots, images, etc ). L’entraînement de l’algorithme est un processus itératif. Il faut noter que la qualité et la quantité des données utilisées pour former l'algorithme peut avoir un impact significatif sur la précision et l'efficacité de l'algorithme formé.

- Apprentissage par renforcement : Cette méthode d'apprentissage suppose la fourniture à l'algorithme des « récompenses » ou des « pénalités » pour encourager les comportements souhaités ou inciter à en adopter d’autres. L'algorithme apporte des modifications à ses sous-programmes en fonction des « récompenses » ou « pénalités » qu'il reçoit, ce qui lui permet d'améliorer sa performance au fil du temps. La machine explore elle-même les possibilités qui lui sont offertes pour rechercher comment optimiser ses chances de réussite (deep learning). Ces algorithmes apprennent et améliorent leurs performances de façon autonome dans l’exécution de tâches spécifiques. - Les algorithmes d'Intelligence Artificielle

- Les algorithmes d'IA pour les données étiquetées

. Les algorithmes de régression statistique, permettent d’évaluer les corrélations significatives entre les données : la régression est utilisée pour indiquer la valeur d’une donnée dépendante compatible statistiquement avec une donnée connue indépendante.

. L’arbre de décision permet d’établir une conclusion basée sur un ensemble de règles de décisions au regard de données classifiées. Une « random forest » ou « foret aléatoire » composée de plusieurs arbres de décision qui produisent chacun une estimation, permet la combinaison des résultats qui va donner la meilleure solution finale la plus probable.

. Les algorithmes de SVM (Support Vector Machine, principe de base des Margin Classifiers) résolvent des problèmes de classification et des problèmes de régression.

- Les algorithmes d'IA pour les données non étiquetées

Pour les données non étiquetées, les algorithmes de « clustering » permettent d’identifier les groupes ayant des similitudes, à les classifier et à les étiqueter en fonction du groupe auquel ils appartiennent.

Les algorithmes d’association découvrent des relations dans les données, et servent à identifier leurs « règles d’association ».

- Les usages de l’intelligence artificielle en entreprise

L’utilisation de l’IA dans les entreprises est devenue de plus en plus fréquente et de plus en plus sophistiquée : avec sa capacité d’apprentissage, l’IA se diffuse dans toutes les activités de l’entreprise, de la chaine de production, à la relation client, en passant par la logistique, la recherche, ou encore les ressources humaines.

- La robotique

Au début du deuxième millénaire, la robotique industrielle se limitait aux chaines robotiques de production de masse (du type des robots de soudure ou de peinture dans l’industrie automobile), en exécutant un ensemble de tâches programmées avec des consignes assez simples à un poste fixe ; mais, grâce aux progrès de l’intelligence artificielle, des capacités de traitement de données en temps réel, des capteurs (1) miniaturisés, des actionneurs précis (2) et de la mécatronique, on voit apparaître de plus en plus des robots aux connaissances cognitives accrues, dotés d’une vision et de possibilités d’apprentissage, de reconnaissance d’objets et d’attitudes, de mobilité et d’autonomie.

(1) Capteurs (proximité, pression, position, fin de course, luminosité, humidité, vitesse, accélération, température ...)

(2) Actionneurs (vérins, vannes, moteurs, afficheurs / voyants ...)

Les robots industriels améliorent considérablement la productivité en réduisant drastiquement les coûts de main d'œuvre et sont de plus en plus utilisés dans l’industrie et la logistique dans les travaux routiniers et dangereux et participent aussi de la sorte à améliorer les conditions de travail dans les ambiances de charge physique importante ou répétitive, de nuisances sonores, chimiques, radiologiques, biologiques. La croissance mondiale de la robotique dans l’industrie et la logistique est importante, mais il existe aussi une forte demande répondant à des besoins spécifiques de nombreux secteurs comme dans la santé, l’agriculture ou encore le commerce.

Quant aux nouveaux robots collaboratifs (cobots) qui partagent un même espace de travail, en réalisant des travaux avec les opérateurs aux postes de travail les plus dangereux ou les plus pénibles (service professionnel, assistance physique ...), ils représentent à la fois une grande opportunité d’améliorer la compétitivité et un effet bénéfique global sur la santé du travail pour la sécurité des travailleurs qui interagissent avec ces machines. Les utilisations nouvelles des robots industriels collaboratifs, comme l’aide ou l’assistance à la manipulation de charge, permettent de les sortir des usines et de travailler sur les chantiers du BTP par exemple, ou prendre l’allure de robots de service plus ou moins autonomes dans la réalisation de tâches de nettoyage, de tri, etc.

- Les interfaces conversationnels

De plus en plus d’entreprises utilisent les interfaces conversationnels (chatbots) ou l’assistance virtuelle dans leurs services d’après-vente ou d’aide à la clientèle ou à la patientèle, avec les capacités de l’intelligence artificielle en matière de traitement automatique des langues (NLP, Natural Language Processing), reconnaissance visuelle et faciale, reconnaissance vocale et verbale, qui comprend le discours et est capable de répondre aux questions qui sont posées. L’intelligence artificielle s’appuie sur les données des clients ou patients et exploite d’autres sources de données disponibles pour donner sa réponse contextualisée, son diagnostic médical, son conseil financier ou sa notation.

Le Machine Learning est utilisé dans les plateformes d’analyse et les outils de CRM (Customer Relationship Management) pour mieux répondre aux questions des clients et prévoir leurs besoins.

- Les outils de prédiction et d’aide à la décision

L’IA permet l’automatisation des contrôles qualité et la détection des défauts de production, la prédiction des défaillances, et l’aide à la prise de décisions dans beaucoup de domaines, en particulier :

• Dans le domaine industriel : systèmes de maintenance prédictive visant à suivre le comportement d’un équipement ou d’une machine dans le temps et à anticiper les pannes avant qu’elles ne se produisent ...

• Dans les ressources humaines pour le processus de recrutement : filtrer les CV, guider le meilleur choix de candidature ...

• Dans le marketing : optimiser les campagnes de promotion et l’affichage ciblé ...

• Dans la finance : algorithmes complexes de trading, choix des meilleurs investissements ...

• Etc.

Les problématiques sécuritaires et éthiques des applications de l’Intelligence Artificielle en entreprise

L’usage omniprésent et invisible de l’intelligence Artificielle en entreprise soulève de nombreuses préoccupations en matière de sécurité et d’éthique :

- sécurité de fonctionnement autonome des machines,

- déshumanisation de prises de décision,

- dérive du monitoring par surveillance algorithmique des tâches

- exploitation des données personnelles,

- etc.

Les enjeux considérables de fiabilité des systèmes de l’IA concernent des dysfonctionnements potentiels majeurs dans l’entreprise de toute la chaine de production, d’administration ou de décision : pertes de données et de confiance, informations incohérentes, conduite erratique et dangereuse, etc.

- Les facteurs générateurs de risque

- Les risques physiques

Les systèmes automatisés intelligents utilisent les méthodes complexes de l’intelligence artificielle de l’apprentissage automatique avec réseaux neuronaux et ne sont pas en mesure d’expliquer de manière facilement interprétable et explicable, même a posteriori, pourquoi les décisions qui ont une incidence sur la sécurité ont été prises : l’opacité de fonctionnement génère donc des risques visibles, tels que le fonctionnement des machines se fiant à un dispositif de commande assisté par apprentissage automatique pour empêcher par exemple que des personnes soient mises en danger par des pièces mobiles d’une machine. Pour réagir à des situations absolument nouvelles qui n’ont pas d’antécédents décrits dans le Big Data, il existe de fortes incertitudes sur le comportement de l’IA en cas de ces évènements totalement imprévus : le seul traitement de grandes quantités de données ne permet pas de prendre en compte correctement des situations inédites.

De plus, comme pour les robots classiques, la vitesse de déplacement du robot et la difficulté d’anticiper certains mouvements de ses parties mobiles, la mise en œuvre d’une énergie considérable, sont des facteurs de risque physique important. Le dysfonctionnement du système robotisé lui-même peut avoir différentes origines : défaillances ou pannes ou modifications hasardeuses des moyens de protection, défaillances du système électronique de commande, du logiciel ... Le risque peut avoir une origine conceptuelle comme la mauvaise disposition des protecteurs ou la mauvaise réaction à une situation anormale.

- Les risques psychologiques

Plus difficiles à appréhender, les risques psychologiques, notamment avec l’usage de robots collaboratifs, sont encore peu connus par manque de recul et d’études, et il existe des lacunes entre les progrès réalisés dans l’application de la robotique de l’IA et sa large et croissante diffusion dans toutes les industries et la connaissance de leur impact sur la santé psychique et l’augmentation du stress au travail :→ Les réponses organisationnelles à toutes les exigences de productivité entrainées par la robotisation qui s’étendent au personnel amené à travailler avec les robots, se caractérisent par une grande augmentation des pressions de toute nature sur les délais, la quantité, la qualité de la production.

- Les risques éthiques

→ L’intensification de la charge mentale due aux nouvelles technologies informatiques ou d’automatisation est facteur de risque psychologique (technostress).

→ L’isolement au sein d’équipes clairsemées et de vastes usines quasi-vides de présence humaine, la réduction d'autonomie, la perte d'identité face à des robots sont des conséquences possibles de la robotisation : interaction constante entre le travailleur et le robot, peu de communication avec son entourage, perte d’initiative ou marge de manœuvre dans les opérations, les cadences et la précision, dépendance à la machine ressentie comme excessive.

→ Anxiété liée à l’évitement et à l’appréhension des contacts répétés avec le robot.

Les risques sur la vulnérabilité et la fuite de données personnelles et confidentielles et les risques éthiques sur les relations sociales entre les salariés et leur employeur concernent aussi les applications de l’IA.

La fuite de données personnelles et leur exploitation abusive suscite des craintes, mais le développement de l’IA soulève aussi de nombreuses questions relatives aux facteurs psychologiques d’acceptabilité : crainte d’intrusion dans la vie personnelle et d’atteinte à la vie privée, inquiétude sur la surveillance constante et minutieuse de la présence, des efforts et de la rapidité de travail à seule fin d’accroitre la productivité.

Cette utilisation croissante de l’IA, au sein des ateliers et bureaux et sur les chantiers va obliger les entreprises à mettre en œuvre une cybersécurité renforcée des objets et des systèmes. En effet, tous ces objets et systèmes directement connectés à un réseau Internet sont très vulnérables aux différentes attaques : vol d’informations, prise en main de l’appareil à distance, modification des données et du contenu.

C’est d’autant plus critique que le volume d’informations énorme générés par des milliers d’utilisateurs nécessite de mettre en place une capacité suffisante et des mesures de sécurité très strictes pour résister aux risques liés à la cybersécurité : le développement d’un monde professionnel totalement connecté offre pour des groupes malveillants de multiples possibilités d’exploiter les défaillances technologiques des dispositifs de l’IA.

La sélection par les algorithmes d’un contenu d’informations ciblées implique que les décisions automatisées sont influencées par les méthodes de l’intelligence artificielle. Les protocoles d'apprentissage, le choix des données d’entraînement, leur qualité et leur quantité affectent directement le résultat et s’ils contiennent des biais, l’algorithme généré aura lui-aussi ces biais, et même pourra les amplifier. Les biais préjudiciables relatifs aux données peuvent être liés à l’endogénéité et/ou à la sélectivité des sources, à l’étroitesse de l’échantillon de l’entraînement et peuvent conduire à des discriminations et des malveillances.

Les mesures de prévention des risques professionnels de l’Intelligence Artificielle

- Les normes et règlements de l’Intelligence Artificielle

La transparence de la finalité de l’algorithme de l’IA, objectifs et modes d’action, est essentielle : le changement fondamental pour les concepteurs de machines nécessite de prendre conscience de tous les enjeux de l'apprentissage machine et de l'algorithme des phases d'entraînement des machines.

En 2021, la Commission Européenne a présenté une proposition concernant un règlement sur l’IA qui contiendraient des cadres juridiquement contraignants pour son utilisation, “en faveur de l’excellence et de la confiance dans l’intelligence artificielle” et propose une approche des systèmes d’IA selon plusieurs niveaux de risque. : “La constitution du tout premier cadre juridique sur l’IA et d’un nouveau plan coordonné avec les états membres garantiront la sécurité et les droits fondamentaux des personnes et des entreprises, tout en renforçant l’adoption, l’investissement et l’innovation de l’IA dans toute l’UE. De nouvelles règles sur les machines et les équipements compléteront cette approche en adaptant les règles de sécurité pour accroître la confiance des utilisateurs dans la nouvelle génération polyvalente de produits.”

Les approches réglementaires (norme ISO/TR 22100-53, proposition de mise à jour de la directive « Machines » n° 2006/42/CE) va obliger les concepteurs des machines intégrant de l’IA à créer des équipements aptes à créer de nouvelles fonctions sans nuire à la sécurité, en décrivant les méthodes utilisées pour entrainer automatiquement les machines. Des exigences complètes, claires et vérifiables sur les cas pour lesquels des décisions prises par des méthodes de l’IA ont une incidence sur la sécurité, doivent être impérativement respectées.

Les critères de conformité doivent contenir des indications sur :- la spécification et la modélisation,

- l’« explicabilité » des décisions (obligation d’explication des décisions algorithmiques) : étant donné que les décisions des systèmes et objets dotés d’IA seront de plus en plus présentes, l’explicabilité de leur comportement devient cruciale, en particulier en y adjoignant des algorithmes capables de donner eux-mêmes les raisons de leurs choix à la demande,

- la « compréhensibilité » des décisions (connaissances permettant d’avoir une analyse critique),

- la « transposabilité » à différentes situations estimées similaires (analogie des performances de l’IA à divers cas d’application),

- la vérification et la validation du système,

- la surveillance pendant l’exécution,

- l’interaction homme – machine (dont capacité à rester décisionnaire),

- la sécurisation et la certification des processus. - Les mesures préventives en robotique collaborative

L’offre robotique développée par les progrès de l’intelligence artificielle (capacité et rapidité de calcul et apprentissage), de la communication, et de la mobilité mécatronique, sort les robots de leur cage et les fait évoluer à proximité de leur utilisateur, imposant des solutions de sécurité plus " immatérielle ", basée sur des logiciels, des capteurs, et une sécurité fonctionnelle des systèmes de commande électriques et électroniques programmables : l’objectif est d’anticiper, d’éviter les collisions ou d’en réduire les effets. Un élément essentiel de ces robots collaboratifs est donc de surveiller, de manière ciblée et sûre, tous les mouvements du robot afin de le stopper ou le dévier immédiatement si la vitesse ou la force exercée sont trop élevées. Il s’agit d’avoir à la fois un robot multitâche et qui n’ait plus aucun protecteur fixe tout en étant sûr.

Pour intégrer correctement la sécurité des robots collaboratifs, il faut fixer les paramètres de fonctionnement et de contrôle sécuritaire et ergonomique : vitesse maximale de collaboration, limite de puissance de force, surveillance de la distance de sécurité avec l’opérateur avec garantie de détection et de temps de réaction, gestion des événements imprévus ... Ce qui nécessite des capteurs électroniques mesurant les distances, les efforts, ... et un automate programmable et un logiciel dédié prenant en compte ces éléments et transmettant ses instructions à des organes actionneurs et effecteurs électriques et mécaniques. - Les mesures préventives de protection des données

Sur la préservation de la vie privée du travailleur et la protection de ses données, si le RGPD apporte des éléments de réponses, il faut des dispositions nouvelles pour les travailleurs en matière d’accès aux données et à leur utilisation. Des règles en matière de surveillance, de suivi et de contrôle sont aussi nécessaires pour se protéger des risques d’exagération et de violation de leurs droits.

Une cybersécurité renforcée doit s'assurer que toutes les données sont cryptées. Les entreprises doivent être particulièrement vigilantes au traitement des données associées à l’identité du travailleur, aux personnes ayant accès à ces données et au stockage de ces données car ces données peuvent aussi être utilisées à des fins de surveillance. Ces dispositifs doivent se conformer à la fois aux règles dictées par la loi Informatique et Libertés (loi n° 78-17 du 6 janvier 1978) et au règlement européen sur la protection des données (RGPD de mai 2018) : principe de finalité, consentement et information des personnes et conservation limitée des données, droit à la portabilité des données, droit à l’oubli, droit à la limitation du traitement, droit d’opposition au profilage, désignation d’un Délégué à la Protection des Données. Une déclaration auprès de la CNIL est à déposer pour pouvoir traiter ces informations en toute légitimité.

Au-delà de la conformité avec les lois en vigueur, bonne information et conduite adéquate du changement sont indispensables pour le succès d’un déploiement de l’IA au travail : il faut discuter, sensibiliser et convaincre les travailleurs de l’intérêt, s’assurer de leur accord avant la mise en œuvre et les rassurer sur l’utilisation et le stockage des données.

Il y a intérêt d’accompagner le changement lié à un projet de développement de l’IA par une démarche globale et participative au niveau de l'entreprise : c’est ainsi que l’entreprise pourra conjurer les menaces de cette innovation et profiter des opportunités que recèlent toujours une situation évolutive ou une période de transition et d’incertitude, en facilitant l'acceptation des changements et en réduisant les facteurs de rejet, notamment chez les travailleurs les plus âgés. La phase de formation et de familiarisation des utilisateurs avec l’IA est primordiale et il ne faut pas négliger le temps nécessaire à son acceptation sociale. Les jeunes travailleurs, plus réceptifs à ces nouveautés technologiques peuvent s’impliquer plus facilement dans l’adoption de l’IA, et de ces robots collaboratifs notamment.

Pour aller plus loin :

• OFFICIEL PREVENTION : FORMATION CONSEILS FICHES MÉTIER : LA PRÉVENTION DES RISQUES DE LA ROBOTISATION INDUSTRIELLE : https://www.officiel-prevention.com/dossier/formation/fiches-metier/la-prevention-des-risques-de-la-robotisation-industrielle

• INRS : Prévention des risques professionnels liés à l’émergence des intelligences artificielles dans les machines : éclairer les enjeux : Référence EL 2020-005 ;

• INRS : Enjeux sécurité de l’IA dans les machines : Référence 6/7/2021-AICHI-SIAS 2020 - 10ème Conférence Internationale « Safety of Industrial Automated Systems »

Janvier 2022

Partagez et diffusez ce dossier

Laissez un commentaire

Votre adresse de messagerie ne sera pas publiée.